- 1. Quais são alguns LLMs atuais?

- 2. Como funcionam os LLMs

- 3. Benefícios dos LLMs

- 4. Desafios dos LLMs

- 5. Casos de uso e opções de implantação do LLM

- 6. Preocupações com a segurança do LLM

- 7. Os dez melhores da OWASP: Riscos de segurança do LLM

- 8. Perguntas frequentes sobre o modelo de idioma grande

O que são grandes modelos de linguagem (LLMs)?

Os grandes modelos de linguagem (LLMs) são um desenvolvimento de ponta em processamento de linguagem natural (PLN) projetado para entender e gerar linguagem humana. Os LLMs são modelos avançados de IA treinados em grandes quantidades de dados de texto, o que lhes permite reconhecer padrões linguísticos, compreender o contexto e produzir respostas coerentes e contextualmente relevantes. Embora a PNL forneça as técnicas fundamentais para que as máquinas lidem com a linguagem, os LLMs representam uma abordagem especializada que aprimorou significativamente a capacidade da máquina de imitar a compreensão e a geração de linguagem semelhantes às humanas.

Quais são alguns LLMs atuais?

Os LLMs representam a fronteira do processamento de linguagem natural, e vários modelos atualmente dominam o espaço, incluindo o Gemini do Google, o Galactica e o Llama da Meta, a série GPT da OpenAI e outros como o Falcon 40B e o Phi-1. Com arquiteturas e tamanhos de parâmetros variados, esses modelos são excelentes em tarefas que vão desde a resposta a consultas até a geração de textos coerentes e contextualmente relevantes em trechos longos.

O BERT, apresentado pelo Google, estabeleceu as bases fundamentais com sua arquitetura baseada em transformadores. Por outro lado, o Meta's Galactica, um participante recente, tem como alvo explícito a comunidade científica e está sendo examinado por produzir "alucinações" enganosas que podem ter implicações profundas no domínio científico. Enquanto isso, a série GPT da OpenAI, especialmente a GPT-3 e a GPT-4, tem sido inovadora em sua capacidade, com a última, segundo rumores, contendo mais de 170 trilhões de parâmetros e habilidades para processar textos e imagens. A proeza desse modelo levou a especulações sobre a aproximação da inteligência geral artificial (AGI), uma capacidade teórica da máquina igual ou superior à inteligência humana.

Os desafios, no entanto, persistem. A escala e a complexidade desses modelos podem levar a resultados imprevisíveis, e seus imensos requisitos de treinamento levantam preocupações sobre a sustentabilidade ambiental e resultados tendenciosos.

No entanto, em meio às preocupações, a evolução dos LLMs promete avanços em diversos setores - desde tarefas mundanas, como melhorias na pesquisa na Web, até áreas críticas, como pesquisa médica e segurança cibernética. À medida que o campo avança, o equilíbrio entre o potencial e a cautela continua sendo fundamental.

Como funcionam os LLMs

Para se destacar na compreensão e geração de linguagem semelhante à humana, os LLMs usam uma combinação de redes neurais, vastos conjuntos de dados de treinamento e uma arquitetura chamada transformadores.

Redes neurais

No centro dos grandes modelos de linguagem estão as redes neurais com várias camadas, conhecidas como modelos de aprendizado profundo. Essas redes consistem em nós interconectados, ou neurônios, que aprendem a reconhecer padrões nos dados de entrada durante a fase de treinamento. Os LLMs são treinados em um grande volume de texto, abrangendo diversas fontes, como sites, livros e artigos, o que lhes permite aprender gramática, sintaxe, semântica e informações contextuais.

Com base em algoritmos projetados para reconhecer padrões, as redes neurais interpretam os dados sensoriais por meio de uma espécie de percepção da máquina, rotulagem ou agrupamento da entrada bruta. As arquiteturas das redes neurais variam de simples redes feedforward, em que as conexões entre os nós não formam um ciclo, a estruturas complexas com camadas sofisticadas e múltiplos loops de feedback.

Redes neurais evolutivas (CNNs): Eles são particularmente eficazes para processar dados com uma topologia semelhante a uma grade. Os exemplos incluem dados de imagem, que podem ser considerados como uma grade 2D de pixels.

Recurrent Neural Networks (RNNs): Eles são adequados para dados sequenciais, como texto e fala. A saída em cada etapa depende dos cálculos anteriores e de um certo tipo de memória sobre o que foi processado até o momento.

Transformadores

A arquitetura do transformador é um componente essencial dos LLMs, apresentado por Vaswani et al. em 2017. Os transformadores abordam as limitações dos modelos de sequência anteriores, como RNNs e LSTMs, que enfrentavam dificuldades com dependências de longo alcance e paralelização. Os transformadores empregam um mecanismo chamado autoatenção, que permite que o modelo pondere a importância de diferentes palavras no contexto de entrada e capture as relações entre elas, independentemente de sua distância na sequência.

Tokenização

A tokenização é a primeira etapa do processamento de texto com um LLM. O texto de entrada é dividido em unidades menores chamadas tokens, que são então convertidas em representações numéricas (vetores) que a rede neural pode processar. Durante o treinamento, o modelo aprende a gerar tokens de saída contextualmente apropriados com base nos tokens de entrada e suas relações.

O processo de treinamento envolve o ajuste dos pesos das conexões da rede neural por meio de uma técnica chamada retropropagação. Ao minimizar a diferença entre as previsões do modelo e os tokens de destino reais nos dados de treinamento, o modelo aprende a gerar uma linguagem mais precisa e coerente.

Depois de treinados, os modelos de linguagem grandes podem ser ajustados em tarefas ou domínios específicos, como análise de sentimentos, resumo ou resposta a perguntas, treinando o modelo por um curto período em um conjunto de dados menor e específico da tarefa. Esse processo permite que o LLM adapte sua compreensão generalizada da linguagem às nuances e aos requisitos da tarefa-alvo.

Artigo relacionado: A inteligência artificial explicada

Benefícios dos LLMs

Os modelos de idiomas grandes oferecem uma ampla gama de benefícios, incluindo:

- Compreensão avançada de linguagem natural: Os LLMs podem entender o contexto e as nuances da linguagem, tornando suas respostas mais relevantes e humanas.

- Versatilidade: Os LLMs podem ser aplicados a várias tarefas, como geração de texto, resumo, tradução e resposta a perguntas, sem exigir treinamento específico para a tarefa.

- Tradução: Os LLMs treinados em vários idiomas podem traduzir com eficácia entre eles. Alguns teorizam que eles poderiam até mesmo derivar significados de idiomas desconhecidos ou perdidos com base em padrões.

- Automatização de tarefas rotineiras: Os LLMs podem executar tarefas relacionadas a textos, como resumir, reformular e gerar conteúdo, o que pode ser especialmente útil para empresas e criadores de conteúdo.

- Habilidades emergentes: Devido à grande quantidade de dados com os quais são treinados, os LLMs podem apresentar recursos inesperados, mas impressionantes, como aritmética em várias etapas, resposta a perguntas complexas e geração de prompts de cadeia de pensamento.

- Depuração e codificação: Na segurança cibernética, os LLMs podem ajudar a escrever e depurar códigos mais rapidamente do que os métodos tradicionais.

- Análise de padrões de ameaças: Na segurança cibernética, os LLMs podem identificar padrões relacionados a ameaças persistentes avançadas, auxiliando na atribuição de incidentes e na mitigação em tempo real.

- Automação de respostas: Nos Centros de Operações de Segurança, os LLMs podem automatizar respostas, gerar scripts e ferramentas e auxiliar na elaboração de relatórios, reduzindo o tempo que os profissionais de segurança gastam em tarefas rotineiras.

Apesar desses benefícios, é essencial lembrar que os LLMs têm desvantagens e considerações éticas que devem ser administradas.

Desafios dos LLMs

Embora seja fácil se deixar levar pelos benefícios proporcionados pelas impressionantes capacidades linguísticas de um LLM, as organizações também devem estar cientes e preparadas para lidar com os possíveis desafios que os acompanham.

Desafios operacionais

- Alucinação: Os LLMs podem, às vezes, produzir resultados bizarros e falsos ou dar a impressão de serem sensíveis. Esses resultados não se baseiam nos dados de treinamento do modelo e são chamados de "alucinações".

- Preconceito: Se um LLM for treinado com dados tendenciosos, seus resultados poderão ser discriminatórios ou tendenciosos em relação a determinados grupos, raças ou classes. Mesmo após o treinamento, as tendências podem evoluir com base nas interações do usuário. A Tay da Microsoft é um exemplo notório de como o preconceito pode se manifestar e aumentar.

- Tokens de falha ou exemplos adversários: São entradas específicas criadas para fazer com que o modelo produza resultados errôneos ou enganosos, causando efetivamente o "mau funcionamento" do modelo.

- Falta de explicabilidade: Pode ser um desafio entender como os LLMs tomam determinadas decisões ou geram resultados específicos, o que dificulta a solução de problemas ou o aperfeiçoamento dos mesmos.

- Excesso de confiança: À medida que os LLMs se tornam mais integrados a vários setores, há o risco de dependência excessiva, o que pode deixar de lado a experiência e a intuição humanas.

Casos de uso e opções de implantação do LLM

Os LLMs oferecem às organizações uma série de padrões de implementação opcionais, cada um deles baseado em um conjunto diferente de ferramentas e implicações de segurança relacionadas.

Uso de LLMs pré-treinados

Provedores de nuvem como a OpenAI e a Anthropic oferecem acesso à API para LLMs avançados que eles gerenciam e protegem. As organizações podem aproveitar essas APIs para incorporar recursos de LLM em seus aplicativos sem precisar gerenciar a infraestrutura subjacente.

Como alternativa, os LLMs de código aberto, como o LLaMa da Meta, podem ser executados na infraestrutura da própria organização, proporcionando mais controle e opções de personalização. No lado negativo, os LLMs de código aberto exigem recursos de computação significativos e conhecimento especializado em IA para serem implementados e mantidos com segurança.

Modelos de implantação de LLMs

- SaaS baseado em API: A infraestrutura é fornecida e gerenciada pelo desenvolvedor do LLM (por exemplo, OpenAI) e provisionada por meio de uma API pública.

- CSP-managed: O LLM é implantado na infraestrutura fornecida por hiperescaladores de nuvem e pode ser executado em uma nuvem privada ou pública, como Azure, OpenAI e Amazon Bedrock.

- Autogerenciado: O LLM é implantado na própria infraestrutura da empresa, o que é relevante apenas para modelos de código aberto ou desenvolvidos internamente.

Os LLMs pré-treinados oferecem várias funcionalidades - geração de conteúdo, chatbots, análise de sentimentos, tradução de idiomas e assistentes de código. Uma empresa de comércio eletrônico pode usar um LLM para gerar descrições de produtos, enquanto uma empresa de desenvolvimento de software pode aproveitar um assistente de codificação com LLM para aumentar a produtividade do programador.

Implicações de segurança associadas a LLMs pré-treinados

A disponibilidade de APIs em nuvem de fácil acesso e modelos de código aberto reduziu drasticamente as barreiras para adicionar recursos avançados de linguagem de IA aos aplicativos. Agora, os desenvolvedores podem inserir LLMs em seus softwares sem precisar de um conhecimento profundo em IA e ML. Embora isso acelere a inovação, aumenta o risco de projetos de IA paralelos que não têm a devida supervisão de segurança e conformidade. Enquanto isso, as equipes de desenvolvimento podem estar fazendo experiências com LLMs sem considerar totalmente a privacidade dos dados, a governança do modeloe as questões de controle de resultados.

Ajuste fino e geração aumentada por recuperação (RAG)

Para personalizar os LLMs para aplicativos específicos, as organizações podem ajustá-los em conjuntos de dados menores relacionados à tarefa desejada ou implementar o RAG, que envolve a integração de LLMs com bases de conhecimento para resposta a perguntas e resumo de conteúdo.

Os casos de uso incluem assistentes de IA especializados com acesso a dados internos (por exemplo, para suporte ao cliente, RH ou helpdesk de TI) e aplicativos de perguntas e respostas (por exemplo, para documentação, repositórios de código ou materiais de treinamento). Por exemplo, o chatbot de atendimento ao cliente de uma empresa de telecomunicações poderia ser ajustado com base na documentação do produto, nas perguntas frequentes ou em interações de suporte anteriores para ajudar melhor os clientes com problemas técnicos e gerenciamento de contas.

Implicações de segurança associadas ao ajuste fino e ao RAG

O ajuste fino e o RAG permitem que as organizações adaptem os LLMs a seus domínios e dados específicos, possibilitando resultados mais direcionados e precisos. No entanto, esse processo de personalização geralmente envolve a exposição do modelo a informações internas confidenciais durante o treinamento. São necessárias práticas sólidas de governança de dados para garantir que apenas os dados autorizados sejam usados para o ajuste fino e que os modelos resultantes sejam protegidos.

Treinamento de modelos

Algumas grandes empresas de tecnologia e instituições de pesquisa optam por investir no treinamento de seus próprios LLMs. Embora esse seja um processo de uso intensivo de recursos, que exige grande capacidade de computação e conjuntos de dados, ele oferece às organizações controle total sobre a arquitetura do modelo, os dados de treinamento e o processo de otimização. Além disso, a organização mantém todos os direitos de propriedade intelectual sobre os modelos resultantes.

O treinamento de modelos pode resultar em aplicações avançadas, como descoberta de medicamentos, ciência dos materiais ou sistemas autônomos. Uma organização de saúde poderia desenvolver um modelo para ajudar a diagnosticar doenças a partir de registros médicos e dados de imagem, por exemplo.

Implicações de segurança associadas ao treinamento de modelos

O treinamento de LLMs personalizados levanta questões difíceis sobre como manter a responsabilidade e a auditabilidade do comportamento do modelo ao lidar com modelos complexos de caixa preta. O próprio processo de treinamento consome enormes recursos de computação, exigindo forte isolamento e controles de acesso ao redor do ambiente de treinamento para evitar abusos ou interferências. Primeiro, a organização deve construir uma infraestrutura de computação de alto desempenho e selecionar cuidadosamente conjuntos de dados maciços, o que pode introduzir novos desafios de segurança.

Preocupações com a segurança do LLM

Uma das principais preocupações com a implantação de grandes modelos de linguagem em ambientes empresariais é a possível inclusão de dados confidenciais durante o treinamento. Uma vez que os dados tenham sido incorporados a esses modelos, torna-se difícil discernir com precisão quais informações foram inseridas neles. Essa falta de visibilidade pode ser problemática quando se considera a miríade de fontes de dados usadas para treinamento e os vários indivíduos que podem acessar esses dados.

Garantir a visibilidade das fontes de dados e manter um controle rigoroso sobre quem tem acesso a elas é fundamental para evitar a exposição não intencional de informações confidenciais.

Uma preocupação adicional é o possível uso indevido de LLMs em ataques cibernéticos. Atores mal-intencionados podem utilizar LLMs para criar e-mails de phishing persuasivos para enganar indivíduos e obter acesso não autorizado a dados confidenciais. Esse método, conhecido como engenharia social, tem o potencial de criar conteúdo convincente e enganoso, aumentando os desafios da proteção de dados.

Sem controles de acesso e proteções rigorosos, o risco de violações de dados significativas aumenta, com agentes mal-intencionados ganhando a capacidade de disseminar desinformação, propaganda ou outros conteúdos prejudiciais com facilidade.

Embora os LLMs tenham aplicações positivas quase infinitas, eles têm o potencial de criar códigos maliciosos, contornando os filtros convencionais para evitar tais comportamentos. Essa suscetibilidade pode levar a uma nova era de ameaças cibernéticas, em que os vazamentos de dados não são apenas para roubar informações, mas para gerar conteúdo e códigos perigosos.

Se manipulados, por exemplo, os LLMs podem produzir softwares, scripts ou ferramentas mal-intencionados que podem comprometer sistemas inteiros. Seu potencial de "hacking de recompensa" gera alarmes no domínio da segurança cibernética, sugerindo que métodos não intencionais para cumprir seus objetivos poderiam ser descobertos, levando ao acesso acidental ou à coleta de dados sensíveis.

Como dependemos cada vez mais dos aplicativos de LLM, torna-se imperativo que as organizações e os indivíduos permaneçam atentos a essas ameaças emergentes, preparados para proteger os dados em todos os momentos.

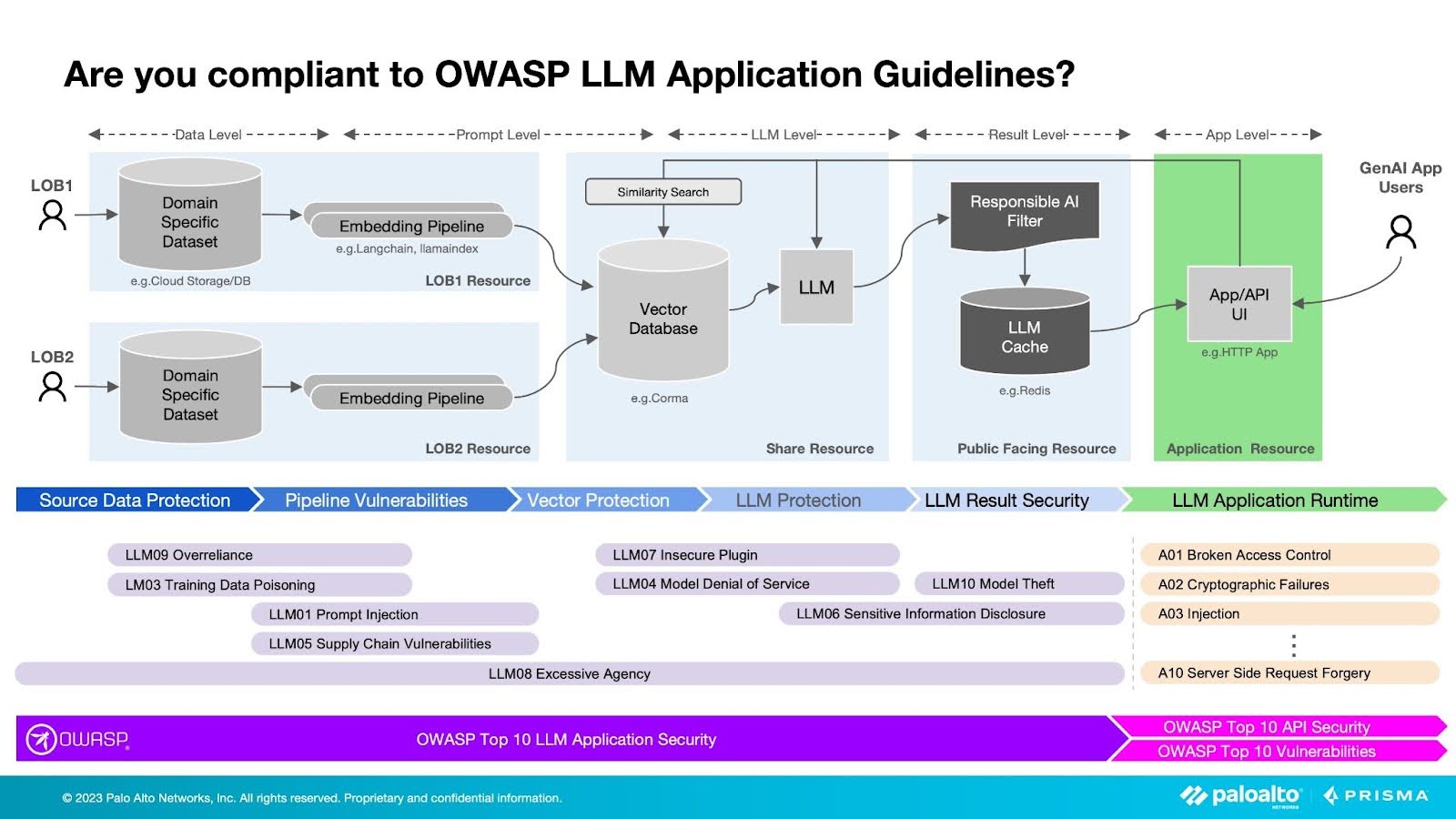

Figura 1: Protegendo os LLMs dos principais riscos de segurança do OWASP

Os dez melhores da OWASP: Riscos de segurança do LLM

As vulnerabilidades convencionais dos aplicativos apresentam um novo tipo de risco de segurança nos LLMs. Mas, como de costume, a OWASP entregou o OWASP Top Ten LLM Security Risks em tempo hábil, alertando os desenvolvedores sobre novos mecanismos e a necessidade de adaptar as estratégias tradicionais de correção para seus aplicativos que utilizam LLMs.

LLM01: Injeção imediata

A injeção de prompt pode manipular um modelo de linguagem grande por meio de entradas desonestas, fazendo com que o LLM execute as intenções do invasor. Com injeções diretas, o malfeitor substitui os prompts do sistema. Com injeções de prompt indiretas, os invasores manipulam entradas de fontes externas. Qualquer um dos métodos pode resultar em exfiltração de dados, engenharia social e outros problemas.

LLM02: Tratamento inseguro de saída

O tratamento inseguro da saída é uma vulnerabilidade que ocorre quando uma saída do LLM é aceita sem análise, expondo os sistemas de back-end. Isso ocorre quando um componente downstream aceita cegamente a saída do LLM sem uma análise efetiva. O uso indevido pode levar a scripts entre sites (XSS) e falsificação de solicitações entre sites (CSRF) em navegadores da Web, bem como falsificação de solicitações do lado do servidor (SSRF), escalonamento de privilégios e execução remota de códigos em sistemas back-end.

LLM03: Envenenamento de dados de treinamento

O envenenamento de dados de treinamento ocorre quando os dados de treinamento do LLM são manipulados por meio do Common Crawl, WebText, OpenWebText, livros e outras fontes. A manipulação introduz backdoors, vulnerabilidades ou vieses que comprometem a segurança do LLM e resultam em queda de desempenho, exploração de software downstream e danos à reputação.

LLM04: Modelo de negação de serviço

A negação de serviço do modelo ocorre quando um invasor explora um LLM para acionar uma operação que consome muitos recursos, levando à degradação do serviço e ao aumento dos custos. Essa vulnerabilidade é ampliada pela natureza exigente dos LLMs e pela natureza imprevisível das entradas do usuário. Em um cenário modelo de negação de serviço, um invasor se envolve com um LLM de uma forma que exige uma quantidade desproporcional de recursos, causando uma queda na qualidade do serviço tanto para o invasor quanto para outros usuários e, ao mesmo tempo, gerando despesas significativas de recursos.

LLM05: Vulnerabilidades da cadeia de suprimentos

As vulnerabilidades da cadeia de suprimentos nos LLMs podem comprometer os dados de treinamento, os modelos de ML e as plataformas de implantação, causando violações de segurança ou falhas totais no sistema. Os componentes ou serviços vulneráveis podem surgir de dados de treinamento envenenados, plug-ins inseguros, software desatualizado ou modelos pré-treinados suscetíveis.

LLM06: Divulgação de informações confidenciais

Os aplicativos LLM podem expor dados sensíveis, informações confidenciais e algoritmos proprietários, levando a acesso não autorizado, roubo de propriedade intelectual e violações de dados. Para mitigar esses riscos, os aplicativos de LLM devem empregar a sanitização de dados, implementar políticas de usuário rigorosas e adequadas e restringir os tipos de dados retornados pelo LLM.

LLM07: Projeto de plug-in inseguro

Os plug-ins podem incluir entradas inseguras e controle de acessoinsuficiente, tornando-os propensos a solicitações mal-intencionadas que podem levar à exfiltração de dados, execução remota de código e escalonamento de privilégios. Os desenvolvedores devem seguir entradas parametrizadas rigorosas e diretrizes de controle de acesso seguro para evitar a exploração.

LLM08: Agência excessiva

O excesso de agência refere-se a sistemas baseados em LLM que realizam ações que levam a consequências não intencionais. A vulnerabilidade decorre da concessão de muita autonomia, excesso de funcionalidade ou permissões excessivas ao LLM. Os desenvolvedores devem limitar a funcionalidade do plug-in ao que é absolutamente essencial. Eles também devem rastrear a autorização do usuário, exigir aprovação humana para todas as ações e implementar a autorização em sistemas downstream.

LLM09: Excesso de confiança

Um LLM pode gerar conteúdo inadequado quando usuários humanos ou sistemas dependem excessivamente do LLM sem fornecer supervisão adequada. As possíveis consequências do LLM09 incluem desinformação, vulnerabilidades de segurança e questões legais.

LLM10: Roubo de modelo

O roubo de modelos de LLM envolve acesso não autorizado, cópia ou exfiltração de LLMs proprietários. O roubo de modelos resulta em perda financeira e perda de vantagem competitiva, além de danos à reputação e acesso não autorizado a dados confidenciais. As organizações devem aplicar medidas de segurança rigorosas para proteger seus LLMs proprietários.

Perguntas frequentes sobre o modelo de idioma grande

A PNL é um subcampo da IA e da linguística que se concentra em permitir que os computadores entendam, interpretem e gerem a linguagem humana. A PNL abrange uma ampla gama de tarefas, incluindo análise de sentimentos, tradução automática, resumo de texto e reconhecimento de entidades nomeadas. As técnicas de PLN normalmente envolvem algoritmos computacionais, modelagem estatística e aprendizado de máquina para processar e analisar dados textuais.

Um LLM é um tipo de modelo de aprendizado profundo, especificamente uma rede neural, projetado para lidar com tarefas de PNL em grande escala. Os LLMs, como o GPT-3 e o BERT, são treinados em grandes quantidades de dados de texto para aprender padrões complexos de linguagem, gramática e semântica. Esses modelos utilizam uma técnica chamada arquitetura de transformador, que permite capturar dependências de longo alcance e informações contextuais na linguagem.

A principal diferença entre a PNL e a LLM é que a PNL é um campo mais amplo que abrange várias técnicas e abordagens para o processamento da linguagem humana, enquanto a LLM é um tipo específico de modelo de rede neural projetado para tarefas avançadas de PNL. Os LLMs representam uma abordagem de última geração no domínio da PNL, oferecendo desempenho e recursos aprimorados na compreensão e geração de linguagem semelhante à humana em comparação com os métodos tradicionais de PNL.

As redes adversárias generativas (GANs) são uma classe de modelos de aprendizado de máquina projetados para gerar novas amostras de dados que se assemelham a um determinado conjunto de dados. As GANs consistem em duas redes neurais, um gerador e um discriminador, que são treinadas simultaneamente de forma competitiva. O gerador cria amostras sintéticas, enquanto o discriminador avalia as amostras geradas e as distingue dos dados reais.

O gerador melhora continuamente seus recursos de geração de dados ao tentar enganar o discriminador, que, por sua vez, refina sua capacidade de identificar amostras reais versus amostras geradas. Esse processo contraditório continua até que as amostras geradas se tornem quase indistinguíveis dos dados reais, tornando os GANs particularmente úteis em aplicações como síntese de imagens, aumento de dados e transferência de estilo.

Os autoencoders variacionais (VAEs) são um tipo de modelo generativo que aprende a representar distribuições de dados complexas codificando os dados de entrada em um espaço latente de dimensão inferior e, em seguida, reconstruindo os dados a partir dessa representação comprimida. Os VAEs consistem em duas redes neurais: um codificador que mapeia os dados de entrada para uma distribuição de probabilidade no espaço latente e um decodificador que reconstrói os dados a partir de pontos amostrados nessa distribuição.

O modelo VAE é treinado para minimizar o erro de reconstrução e um termo de regularização que incentiva a distribuição aprendida a se alinhar com uma distribuição prévia predefinida. Os VAEs são capazes de gerar novas amostras de dados por meio da decodificação de pontos aleatórios amostrados do espaço latente, o que os torna adequados para aplicações como geração de imagens, remoção de ruídos de dados e aprendizado de representação.